汉语词语语义相似度计算研究

文本相似度算法

1.信息检索中的重要发明TF-IDF 1.1TF Term frequency即关键词词频,是指一篇文章中关键词出现的频率,比如在一篇M个词的文章中有N个该关键词,则 (公式1.1-1) 为该关键词在这篇文章中的词频。 1.2IDF Inverse document frequency指逆向文本频率,是用于衡量关键词权重的指数,由公式 (公式1.2-1) 计算而得,其中D为文章总数,Dw为关键词出现过的文章数。2.基于空间向量的余弦算法 2.1算法步骤 预处理→文本特征项选择→加权→生成向量空间模型后计算余弦。 2.2步骤简介 2.2.1预处理 预处理主要是进行中文分词和去停用词,分词的开源代码有:ICTCLAS。 然后按照停用词表中的词语将语料中对文本内容识别意义不大但出

现频率很高的词、符号、标点及乱码等去掉。如“这,的,和,会,为”等词几乎出现在任何一篇中文文本中,但是它们对这个文本所表达的意思几乎没有任何贡献。使用停用词列表来剔除停用词的过程很简单,就是一个查询过程:对每一个词条,看其是否位于停用词列表中,如果是则将其从词条串中删除。 图2.2.1-1中文文本相似度算法预处理流程 2.2.2文本特征项选择与加权 过滤掉常用副词、助词等频度高的词之后,根据剩下词的频度确定若干关键词。频度计算参照TF公式。 加权是针对每个关键词对文本特征的体现效果大小不同而设置的机制,权值计算参照IDF公式。 2.2.3向量空间模型VSM及余弦计算 向量空间模型的基本思想是把文档简化为以特征项(关键词)的权重为分量的N维向量表示。

这个模型假设词与词间不相关(这个前提造成这个模型无法进行语义相关的判断,向量空间模型的缺点在于关键词之间的线性无关的假说前提),用向量来表示文本,从而简化了文本中的关键词之间的复杂关系,文档用十分简单的向量表示,使得模型具备了可计算性。 在向量空间模型中,文本泛指各种机器可读的记录。 用D(Document)表示文本,特征项(Term,用t表示)指出现在文档D中且能够代表该文档内容的基本语言单位,主要是由词或者短语构成,文本可以用特征项集表示为D(T1,T2,…,Tn),其中Tk是特征项,要求满足1<=k<=N。 下面是向量空间模型(特指权值向量空间)的解释。 假设一篇文档中有a、b、c、d四个特征项,那么这篇文档就可以表示为 D(a,b,c,d) 对于其它要与之比较的文本,也将遵从这个特征项顺序。对含有n 个特征项的文本而言,通常会给每个特征项赋予一定的权重表示其重要程度,即 D=D(T1,W1;T2,W2;…,Tn,Wn) 简记为 D=D(W1,W2,…,Wn) 我们把它叫做文本D的权值向量表示,其中Wk是Tk的权重,

计算文本相似度几种最常用的方法,并比较它们之间的性能

计算文本相似度几种最常用的方法,并比较它们之间的性能 编者按:本文作者为Yves Peirsman,是NLP领域的专家。在这篇博文中,作者比较了各种计算句子相似度的方法,并了解它们是如何操作的。词嵌入(word embeddings)已经在自然语言处理领域广泛使用,它可以让我们轻易地计算两个词语之间的语义相似性,或者找出与目标词语最相似的词语。然而,人们关注更多的是两个句子或者短文之间的相似度。如果你对代码感兴趣,文中附有讲解细节的Jupyter Notebook地址。以下是论智的编译。 许多NLP应用需要计算两段短文之间的相似性。例如,搜索引擎需要建模,估计一份文本与提问问题之间的关联度,其中涉及到的并不只是看文字是否有重叠。与之相似的,类似Quora之类的问答网站也有这项需求,他们需要判断某一问题是否之前已出现过。要判断这类的文本相似性,首先要对两个短文本进行embedding,然后计算二者之间的余弦相似度(cosine similarity)。尽管word2vec和GloVe等词嵌入已经成为寻找单词间语义相似度的标准方法,但是对于句子嵌入应如何被计算仍存在不同的声音。接下来,我们将回顾一下几种最常用的方法,并比较它们之间的性能。 数据 我们将在两个被广泛使用的数据集上测试所有相似度计算方法,同时还与人类的判断作对比。两个数据集分别是: STS基准收集了2012年至2017年国际语义评测SemEval中所有的英语数据 SICK数据库包含了10000对英语句子,其中的标签说明了它们之间的语义关联和逻辑关系 下面的表格是STS数据集中的几个例子。可以看到,两句话之间的语义关系通常非常微小。例如第四个例子: A man is playing a harp. A man is playing a keyboard.

词语相似度算法的分析与改进

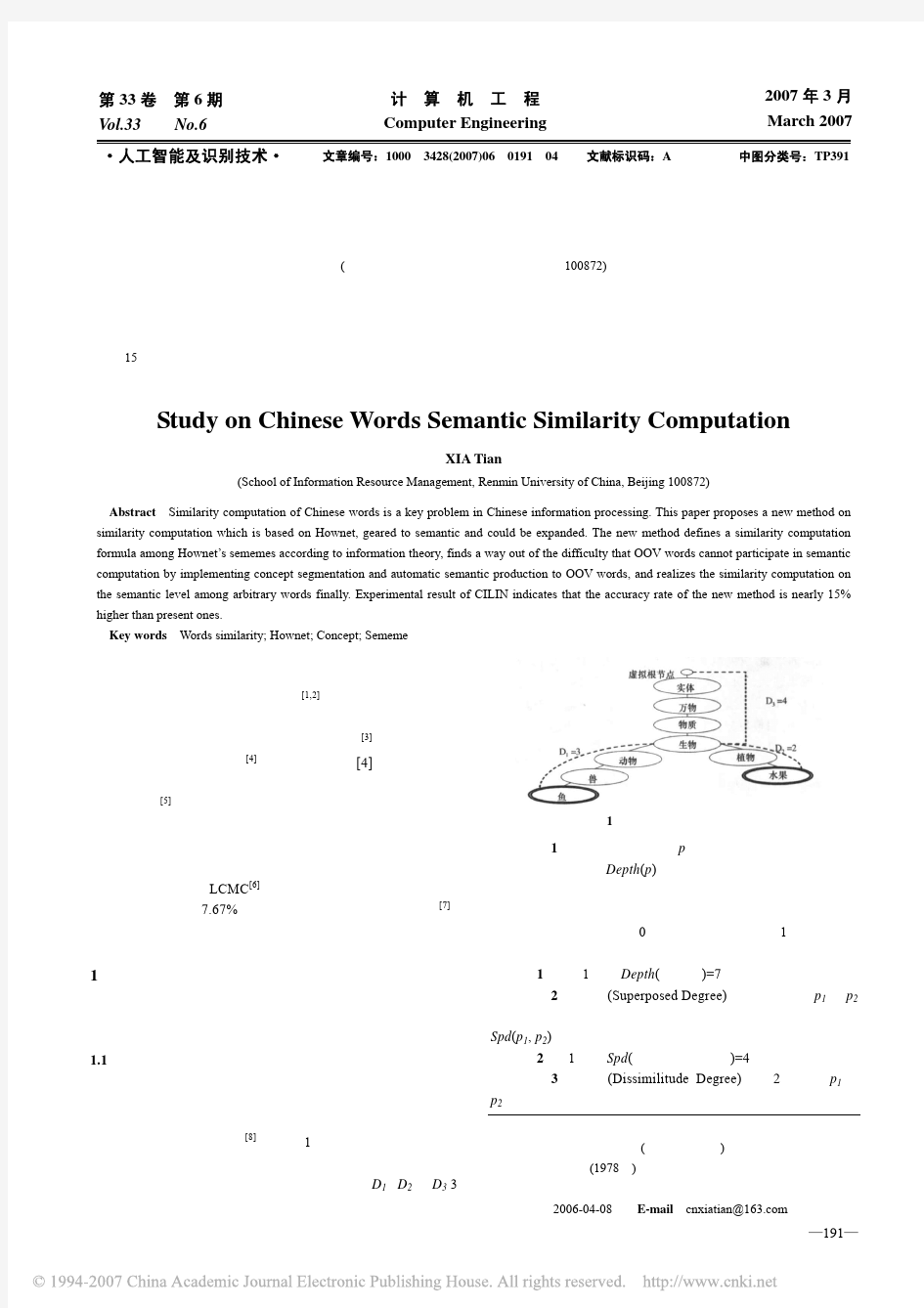

词语相似度算法的分析与改进 摘要:对现有的词语相似度算法进行分析,提出一种基于知网,面向语义、可扩展的词语相似度计算方法,通过对实验结果进行分析,所提出的词语语义相似度计算方法比以前的方法更好,在计算词语相似度时,准确率更高。 关键词:词语相似度算法;义原相似度计算;概念词的相似度计算;非概念词的相似度计算 在建立主观题评分模型时,要判断句子的相似度,计算句子的相似度时,首先要处理的就是词语的相似度计算工作。目前对词语的相似度计算人们已经做了大量的研究,提出了一些较有代表性的计算方法。主要包括以下几种: 1)基于字面信息的词语相似度计算 这种算法的核心内容是:中文词语的构成句子中,一般较核心的内容都放在句子的后面。句子后面的词语在句子中所起到的作用比靠前的词语大。因此在对句子进行分析时需要给后面的字或词赋予较高的权值。 假设a和b分别代表两个词语,按照此算法,词语之间的相似度计算公式可以表示为公式1。 使用字面信息作为相似度计算的算法较简单,实现起来也方便。但该算法准确率不高,尤其是对于语义相似的词语更是难于处理。2)基于词林的词语相似度计算 对于以同义词词林作为语义分类体系进行词语相似度计算的研

究,王斌和章成志都曾作了相关探讨[1]。其核心思想是使用两个词语的语义距离来表示词语间相似度。当处理对象是一个词组或短语时,首先将其切分为义类词,并将义类词在词林的树状结构中提取出相关的语义编码,并对两个词语的语义编码进行相似度计算。基于词林的词语相似度计算较好的解决了语义相似、词形不同的词语相似度计算,但由于语义词典的完备性问题,必然会存在部分不在语义词典中的词语而无法处理。 3)基于知网的词语相似度计算 知网以概念作为描述对象,从关系层次上揭示词语的概念含义,并建立了概念关系网络,包含词语属性以及属性间关系[2]。刘群、李素建从知网的关系描述出发,研究了同一个词义所具有的多个义原间的关系,并试图计算出这些义原在计算相似度时所起到的作用,并根据这种思想提出了使用知网的语义信息来计算词语相似度的算法。 该算法在计算概念词的相似度时较准确,但在计算概念词与非概念词,非概念词与非概念词的相似度时,准确率不高。 为克服这些问题,我们采用知网作为语义资源,结合信息论中的相关理论,提出了一种面向语义的、可扩展的、多策略混合的词语相似度计算模型。 1 义原相似度计算 词语的相似度计算,最终还是要计算各词语的义源相似度。在知网中,所有词语都包含义原信息,应用知网进行相似度计算时,第

浅议语义相似度计算

浅议语义相似度计算 摘要语义相似度研究的是两个词语的相似性,被广 泛应用于信息检索、信息提取、文本词义消歧、机器翻译等领域中。本文介绍几种主要的语义相似度计算方法,以供大 一^, 家参考。 关键词语义相似度词义相似度语义距离 、引言 自然语言的词语之间关系比较复杂,我们又时常要把这 种复杂关系进行比较,所以要将其转化为简单的数量关系,再进行比较。语音相似度计算正是这样的方法。 词语的语义相似度计算有3 种方法:基于知识体系的方 法、基于语料库的方法、基于网络的方法。基于知识体系的方法,大多以WordNet 作为基础。WordNet 是语义字典,它根据词条的意义将词语分组,每一个具有相同意义的字条组称为一个synset (同义词集合)。WordNet为每一个synset提 供了简短,概要的定义,并记录不同synset之间的语义关系。 它用概念之间的语义关系形成符合常识和语法的语义关系图。基于信息量的方法主要是通过词语上下文的信息,用统计的方法求解。基于网络的方法,主要是利用搜索引擎的搜索结果进行计算。 二、语义相似度概念

信息论中任何两个词语的相似度取决于它们的共性 Commonality )和个性( Differences )。公式如下: 其中,分子表示描述A,B 共性所需要的信息量;分母表 示完整地描述A,B 所需要的信息量。 刘群、李素建认为语义相似度就是两个词语在不同的上 文中可以互相替换使用而不改变文本的句法语义结构的程度。两个词语,如果在不同的上下文中可以互相替换且不改变文本的句法语义结构的可能性越大,二者的相似度就越高,否则相似度就越低。对于两个词语 W1,W2 如果记其相似度为Sim (W1 , W2),其词语距离为Dis (W1 , Wz),根 据刘群、李素建的公式: 其中a 是一个可变参数,含义是当相似度为0.5 时的词 语距离值。 相似度被定义为一个0到1 之间的实数,当两个词语完 全一样时,相似度为1 ;是完全不同的概念时,它们的相似度 接近于0。 三、语义相似度的计算方法常用计算方法有基于知识体系的计算,基 于大规模语料 库的计算,基于网络的计算。 一)根据分类体系计算词语语义距离的方法 这种方法也称为基于树的语义相似度计算方法,大体分 为两种:一是基于距离的语义相似性测度是基于信息内容

基于知网的语义相似度计算

基于《知网》的语义相似度计算 软件使用手册 1 功能简介 本软件是根据[刘群2002]一文中的原理编写的词汇语义相似度计算程序。 主要实现了以下功能: 1.1基于交互输入的义原查询、义原距离计算、义原相似度计算 1.2基于交互输入的词语义项查询、义项相似度计算、词语相似度计算; 1.3基于文件输入的词语义项查询、词语相似度计算; 1.4相似度计算中的参数调整。 2 安装说明 本软件包一共有四个文件: 《基于<知网>的词汇语义相似度计算》软件使用手册.doc:本使用手册 《基于<知网>的词汇语义相似度计算》论文.pdf:本软件所依据的论文,采用pdf 格式,用Acrobat Reader阅读时需要安装简体中文支持包。 自然语言处理开放资源许可证.doc:本软件包的授权许可证 WordSimilarity.zip:程序文件 软件安装时,将文件WordSimilarity.zip文件解压缩一个目录下即可,解压缩后有以下几个文件: WordSimilarity.exe:可执行程序; Glossary.dat:《知网》数据文件 Semdict.dat:《知网》数据文件 Whole.dat:《知网》数据文件 必须确保《知网》数据文件在程序执行时的当前目录下。 3 界面说明 软件使用简单的对话框界面,如下所示:

4 功能说明 4.1义原操作 4.1.1 义原查询 1.首先在“输入1”框中输入义原名称; 2.点击“察看义原1”按钮; 3.在“义项1”框中将依次显示出该义原及其所有上位义原的编号、中文、英文;类似的方法可以查询“输入2”框中的义原; 4.1.2 义原距离计算 1.首先在“输入1”和“输入2”框中输入两个义原; 2.点击“计算义原距离”按钮; 3.在“输出”框中显示两个义原的距离;

基于《知网》的词语相似度计算

基于《知网》的词语相似度计算 [摘要]词语相似度计算是计算机中文处理中的基础和重要环节,目前基于《知网》的词语相似度计算是一种常见的方法,本文将对该方法做系统介绍。 [关键词]《知网》词语相似度计算 一、《知网》的结构 《知网》(HowNet)是我国著名机器翻译专家董振东先生和董强先生创建的,是一个常识知识库,它含有丰富的词汇语义知识以及世界知识,内部结构复杂。 《知网》中两个最基础的概念是“概念”和“义原”。“概念”是用来描述词语语义。因为一个词可以含有多个语义,所以一个词需要多个概念来描述。使用“知识表示语言”对概念进行描述,“知识表示语言”使用的“词汇”便是义原。《知网》中的不可再分的、最小的意义单位是“义原”,义原用来描述“概念”。 《知网》采用的义原有1500个,它们一共可以分为十类,具体见图1。 知网反映了概念之间、概念属性之间各种各样的关系,总体来说知网描述了16种关系: 上下位关系;同义关系、反义关系、对义关系;部件-整体关系;属性-宿主关系;材料-成品关系;施事/经验者/关系;主体-事件关系;受事/内容/领属物等事件关系;工具-事件关系;场所-事件关系;时间-事件关系;值-属性关系;实体-值关系;事件-角色关系;相关关系。 由《知网》的结构得知义原之间组成的不是一个树状结构,而是一个复杂的网状结构。然而义原关系中最重要的是上下位关系。所有的“基本义原”以这种上下位关系为基础构成了义原层次体系,叫做义原分类树。在义原分类树中,父节点义原和子节点义原之间具有上下位关系。可以通过义原分类树来计算词语和词语之间的语义距离。 二、知网的知识词典 知识词典是知网中最基本的数据库。在知识词典中,每一个概念(概念又称为义项)可以用一条记录来描述。一条记录含有八项信息,每一项由用“=”连接的两个部分组成,等号左边表示数据的域名,右边是数据的值。比如下面就是一条描述概念的记录: NO=017114

词语相似度计算方法

词语相似度计算方法分析 崔韬世麦范金 桂林理工大学广西 541004 摘要:词语相似度计算是自然语言处理、智能检索、文档聚类、文档分类、自动应答、词义排歧和机器翻译等很多领域的基础研究课题。词语相似度计算在理论研究和实际应用中具有重要意义。本文对词语相似度进行总结,分别阐述了基于大规模语料库的词语相似度计算方法和基于本体的词语相似度计算方法,重点对后者进行详细分析。最后对两类方法进行简单对比,指出各自优缺点。 关键词:词语相似度;语料库;本体 0 引言 词语相似度计算研究的是用什么样的方法来计算或比较两个词语的相似性。词语相似度计算在自然语言处理、智能检索、文本聚类、文本分类、自动应答、词义排歧和机器翻译等领域都有广泛的应用,它是一个基础研究课题,正在为越来越多的研究人员所关注。笔者对词语相似度计算的应用背景、研究成果进行了归纳和总结,包括每种策略的基本思想、依赖的工具和主要的方法等,以供自然语言处理、智能检索、文本聚类、文本分类、数据挖掘、信息提取、自动应答、词义排歧和机器翻译等领域的研究人员参考和应用。词语相似度计算的应用主要有以下几点: (1) 在基于实例的机器翻译中,词语相似度主要用于衡量文本中词语的可替换程度。 (2) 在信息检索中,相似度更多的是反映文本与用户查询在意义上的符合程度。 (3) 在多文档文摘系统中,相似度可以反映出局部主题信息的拟合程度。 (4) 在自动应答系统领域,相似度的计算主要体现在计算用户问句和领域文本内容的相似度上。 (5) 在文本分类研究中,相似度可以反映文本与给定的分类体系中某类别的相关程度。 (6) 相似度计算是文本聚类的基础,通过相似度计算,把文档集合按照文档间的相似度大小分成更小的文本簇。1 基于语料库的词语相似度计算方法 基于统计方法计算词语相似度通常是利用词语的相关性来计算词语的相似度。其理论假设凡是语义相近的词,它们的上下文也应该相似。因此统计的方法对于两个词的相似度算建立在计算它们的相关词向量相似度基础上。首先要选择一组特征词,然后计算这一组特征词与每一个词的相关性(一般用这组词在实际的大规模语料中在该词的上下文中出现的频率来度量),于是,对于每一个词都可以得到一个相关性的特征词向量,然后计算这些向量之间的相似度,一般用向量夹角余弦的计算结果作为这两个词的相似度。 Lee利用相关熵,Brown采用平均互信息来计算词语之间的相似度。李涓子(1999)利用这种思想来实现语义的自动排歧;鲁松(2001)研究了如何利用词语的相关性来计算词语的相似度。PBrownetc采用平均互信息来计算词语之间的相似度。基于统计的定量分析方法能够对词汇间的语义相似性进行比较精确和有效的度量。基于大规模语料库进行的获取受制于所采用的语料库,难以避免数据稀疏问题,由于汉语的一词多义现象,统计的方法得到的结果中含有的噪声是相当大的,常常会出现明显的错误。 2 基于本体库的词语相似度计算方法 2.1 常用本体库 关于Ontology的定义有许多,目前获得较多认同的是R.Studer的解释:“Ontology是对概念体系的明确的、形式

基于《知网》的词汇语义相似度计算

基于《知网》的词汇语义相似度计算1 刘群??李素建? {liuqun,lisujian}@https://www.sodocs.net/doc/d88698871.html, ?中国科学院计算技术研究所 ?北京大学计算语言学研究所 摘要: 《知网》是一部比较详尽的语义知识词典。在基于实例的机器翻译中,词语相似度计算是一个重要的环节。不过,由于《知网》中对于一个词的语义采用的是一种多维的知识表示形式,这给词语相似度的计算带来了麻烦。这一点与WordNet和《同义词词林》不同。在WordNet和《同义词词林》中,所有同类的语义项(WordNet的synset或《同义词词林》的词群)构成一个树状结构,要计算语义项之间的距离,只要计算树状结构中相应结点的距离即可。而在《知网》中词语相似度的计算存在以下问题: 1.每一个词的语义描述由多个义原组成,例如“暗箱”一词的语义描述为:part|部件,%tool|用具,body|身,“写信”一词的语义描述为: #TakePicture|拍摄write|写,ContentProduct=letter|信件; 2.词语的语义描述中各个义原并不是平等的,它们之间有着复杂的关系,通过一种专门的知识描述语言来表示。 我们的工作主要包括: 1.研究《知网》中知识描述语言的语法,了解其描述一个词义所用的多个义原之间的关系,区分其在词语相似度计算中所起的作用; 2.提出利用《知网》进行词语相似度计算的算法; 3.通过实验验证该算法的有效性,并与其他算法进行比较。 关键词:《知网》词汇语义相似度计算自然语言处理 1 引言 在基于实例的机器翻译中,词语相似度的计算有着重要的作用。例如要翻译“张三写的小说”这个短语,通过语料库检索得到译例: 1)李四写的小说/the novel written by Li Si 2)去年写的小说/the novel written last year 通过相似度计算我们发现,“张三”和“李四”都是具体的人,语义上非常相似,而“去年”的语义是时间,和“张三”相似度较低,因此我们选用“李四写的小说”这个实例进行类比翻译,就可以得到正确的译文: the novel written by Zhang San 1本项研究受国家重点基础研究计划(973)支持,项目编号是G1998030507-4和G1998030510。

深度学习解决 NLP 问题:语义相似度计算

导语 在NLP领域,语义相似度的计算一直是个难题:搜索场景下query和Doc的语义相似度、feeds场景下Doc和Doc的语义相似度、机器翻译场景下A句子和B句子的语义相似度等等。本文通过介绍DSSM、CNN-DSSM、LSTM-DSSM 等深度学习模型在计算语义相似度上的应用,希望给读者带来帮助。 0. 提纲 1. 背景 2. DSSM 3. CNN-DSSM 4. LSTM-DSSM 5. 后记 6. 引用 1. 背景 以搜索引擎和搜索广告为例,最重要的也最难解决的问题是语义相似度,这里主要体现在两个方面:召回和排序。

在召回时,传统的文本相似性如BM25,无法有效发现语义类query-Doc 结果对,如"从北京到上海的机票"与"携程网"的相似性、"快递软件"与"菜鸟裹裹"的相似性。 在排序时,一些细微的语言变化往往带来巨大的语义变化,如"小宝宝生病怎么办"和"狗宝宝生病怎么办"、"深度学习"和"学习深度"。 DSSM(Deep Structured Semantic Models)为计算语义相似度提供了一种思路。 本文的最后,笔者结合自身业务,对DSSM 的使用场景做了一些总结,不是所有的业务都适合用DSSM。 2. DSSM DSSM [1](Deep Structured Semantic Models)的原理很简单,通过搜索引擎里Query 和Title 的海量的点击曝光日志,用DNN 把Query 和Title 表达为低纬语义向量,并通过cosine 距离来计算两个语义向量的距离,最终训练出语义相似度模型。该模型既可以用来预测两个句子的语义相似度,又可以获得某句子的低纬语义向量表达。 DSSM 从下往上可以分为三层结构:输入层、表示层、匹配层

词语相似度计算

词语相似度计算 当事物可以计算的时候就产生了智能 ----Alert 一、词语相似度 词义相似度计算在很多领域中都有广泛的应用,例如信息检索、信息抽取、文本分类、词义排歧、基于实例的机器翻译等等。国内很多论文主要是基于同义词林和知网来计算的。本文的词语相似度计算是基于《同义词词林》的。 二、同义词林介绍 《同义词词林》是梅家驹等人于1983年编纂而成,这本词典中不仅包括了一个词语的同义词, 也包含了一定数量的同类词, 即广义的相关。《同义词词林》的编写年代久远,之后没有更新。哈工大花费了大量的人力物力完成了一部具有汉语大词表的哈工大信息检索研究室《同义词词林扩展版》,《同义词词林扩展版》收录词语近7万条。原版的《同义词词林》目录如下:

哈工大《同义词词林扩展版》保留《同义词词林》原有的三层分类体系,并在此基础上对词语继续细分类,增加两层,得到最终的五层分类体系,这样词典中的词语之间就体现了良好的层次关系,如下图表示的词语树形结构: 例如:“东南西北”的编码为Cb02A01=

C是第1层、b是第二层、02是第三层、A是第四层、01是第五层,=号有特殊的意义。词语的编码规则如下: 表中的编码位是按照从左到右的顺序排列。第八位的标记有3种,分别是“=”、“#”、“@”,“=”代表“相等”、“同义”。末尾的“#”代表“不等”、“同类”,属于相关词语。末尾的“@”代表“自我封闭”、“独立”,它在词典中既没有同义词,也没有相关词。 三、词语相似度 定义1语义相似度。给定两个词汇w1和w2,它们之间的相似度通过 Sim(w1,w2):S*S->[0,1],表示集合S中的两个词汇w1和w2的相似程度。 简单的说相似度函数是个值域在[0,1]间的函数。 本文的计算公式参考了《基于同义词词林的词语相似度计算方法》一文,相似度函数计算公式如下: 若两个义项的相似度用Sim表示,n表示所在分枝层分支数,k表示两个分支间的距离。 1.若两个义项不在同一查树上: Sim(A,B) = f 如:人Aa01A01=和实物Ba01A01= 2.若两个义项在同一查树上: 1) 若在第2层分支 Sim(A,B) = a*cos(n*pi/180)*[(n-k+1)/n] 如:人Aa01A01= 和少儿Ab04B01=

语义相似度的计算方法研究

语义相似度的计算方法研究 信息与计算科学余牛指导教师:冉延平 摘要语义相似度计算在信息检索、信息抽取、文本分类、词义排歧、基于实例的机器翻译等很多领域中都有广泛的应用.特别是近几十年来随着Internet技术的高速发展,语义相似度计算成为自然语言处理和信息检索研究的重要组成部分.本文介绍了几种典型的语义相似度的计算方法,总结了语义相似度计算的两类策略,其中重点介绍了一种基于树状结构中语义词典Hownet的语义相似度计算方法,最后对两类主要策略进行了简单的比较.关键词语义相似度;语义距离;知网;语料库 The Reseach of Computing Methods about Semantic Similarity YU Niu (Department of Mathematics and Statistics,Tianshui Normal University , 741000) Abstract Semantic similarity is broadly used in many applications such as information retrieval, information extraction, text classification, word sense disambiguation, example-based machine translation and so on.Especially with the rapid development of Internet technology in recent decades, Calculation of semantic similarity has always been an important part of natural language processing and information retrieval research .This paper introduces several main methods of calculating semantic similarity , then two strategies of semantic similarity measurement are summarized, and we focuse on the Hownet based on the stucture of tree and use them to calculate the semantic similarity ,and finally the two strategies are easily compared . Key words Semantic similarity, Semantic distance,Hownet, Corpus

有关中文文本相似度研究的文献综述

有关中文文本相似度研究的文献综述 摘要随着近年来知识自动化、机器学习和人工智能等领域研究和应用的逐步深入,作为与这些领域相关的基础研究课题之一,文本相似度计算的重要性日益凸显。由于汉语书写的特点,导致中文文本相似度计算较英语等其他自然语言的处理又更加复杂。本文在对近二十年来被引证次数较多的一些相关文献进行分析研究的基础上,从词语、句子、段落及篇章等层面,着重基于语义理解的方法,对汉语文本相似度计算研究的情况进行了综述。 关键词文本相似度计算;文献综述 文本相似度计算在信息检索、数据挖掘、机器翻译、文档复制检测、自然语言处理、自动应答等领域都有着广泛的应用,是相关领域的基础研究课题之一,正在被越来越多的研究人员所关注。文本相似度计算主要采用基于统计学和基于语义理解这两类方法。其中基于统计学的计算方法包括向量空间模型、广义向量空间模型、隐性语义索引模型、基于屬性论的方法、基于海明距离的计算方法、基于数字正文的重构方法等;而中文语义理解又可分为基于知网、同义词词林、中文概念词典等不同的语义知识库。相比而言,基于统计学的计算方法,需要大规模语料库的支持和长时间的训练过程,具有一定的局限性;而基于语义理解的相似度计算方法不需要大规模语料库的支持,也不需要长时间的训练,具有准确率高的特点[2]。另一方面,根据计算的层级不同,文本相似度计算又可分为词语相似度、句子相似度、段落及篇章相似度。 1 词语相似度计算 1.1 基于知网的词语相似度计算 知网(HowNet)是一个以汉语和英语的词语所代表的概念为描述对象,以揭示概念与概念之间以及概念所具有的属性之间的关系为基本内容的常识知识库。在知网中,词汇语义的描述被定义为义项(概念),每一个词可以表达为几个义项。义项又是由一种知识表示语言来描述的,这种知识表示语言所用的词汇称作义原。与一般的语义词典(如同义词词林或WordNet)不同的是,知网语义树并不涵盖所有词语,而是将描述词汇语义的义原用树状结构组织起来,并根据义原之间的属性关系分为多棵义原树,树与树之间又存在一定的关系,从而形成知网所具有的网状知识结构。相比词汇的规模,知网的义原数量很少,只有1500多个,但其组合起来可以表达数以万计的词语[2]。 刘群和李素建提出了利用知网进行词语相似度的计算方法,指出基于知网的网状知识结构特点,可以将词语的相似度计算转化为义原的相似度计算,即通过计算两个待比较义原在义原树结构的距离来确定相似度,从而提高计算效率,并给出了词语相似度的计算公式[1]。金博等在此基础上对义原相似度计算公式进行了改进,引入了表征两个义原在义原树中深度的相对位置影响因子。进而将词语相似度计算方法推广到句子及段落的相似度计算,并通过实验对该算法进行了